Можно ли доверять машине?

Результаты онлайн-эксперимента показывают, что люди предпочитают, чтобы решения о перераспределении принимал искусственный интеллект

Новое исследование показало, что люди предпочитают искусственный интеллект (ИИ) людям, когда речь идет о принятии решений о перераспределении средств.

Поскольку технологии продолжают внедряться в различные аспекты принятия решений в государственном и частном секторах, понимание общественного восприятия и удовлетворенности, а также обеспечение прозрачности и подотчетности алгоритмов будет иметь ключевое значение для их принятия и эффективности.

В исследовании, проведенном учеными из Портсмутского университета и Института инноваций и конкуренции имени Макса Планка, изучалось отношение общества к алгоритмическому и человеческому принятию решений, а также влияние потенциальной дискриминации на эти предпочтения. Исследование опубликовано в журнале Public Choice.

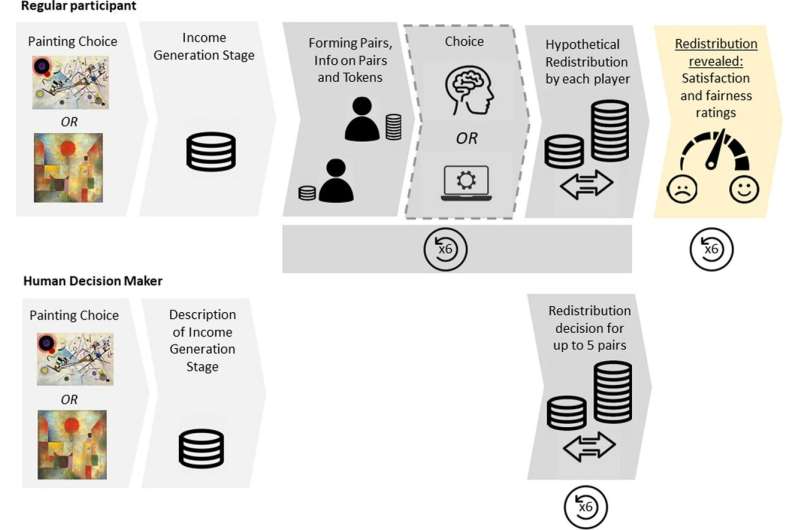

Для изучения предпочтений людей или искусственного интеллекта в принятии решений использовался онлайн-эксперимент, в котором заработок двух людей мог быть перераспределен между ними после выполнения ряда задач. Более 200 участников из Великобритании и Германии попросили проголосовать за то, чтобы человек или алгоритм (ИИ) принимал решение, которое определит, сколько денег они заработают.

В отличие от предыдущих результатов, более 60 % участников предпочли ИИ, а не человека, чтобы решить, как перераспределять заработанное. Участники отдали предпочтение алгоритму, независимо от возможной дискриминации. Такое предпочтение ставит под сомнение общепринятое представление о том, что люди принимают решения, когда речь идет о «моральном» компоненте, таком как справедливость.

Однако, несмотря на предпочтение алгоритмов, при оценке принятых решений участники были менее удовлетворены решением ИИ и сочли его менее «справедливым», чем решение, принятое человеком.

Субъективные оценки решений в основном обусловлены собственными материальными интересами участников и идеалами справедливости. Участники могли мириться с любым разумным отклонением фактического решения от их идеалов, но очень остро и негативно реагировали на решения о перераспределении, которые не соответствовали ни одному из установленных принципов справедливости.

Доктор Вольфганг Лухан, доцент кафедры поведенческой экономики в Школе бухгалтерского учета, экономики и финансов Портсмутского университета и соответствующий автор исследования, сказал: «Наше исследование показывает, что, хотя люди открыты идее алгоритмических лиц, принимающих решения, особенно из-за их потенциала для принятия беспристрастных решений, фактическая производительность и способность объяснить, как они принимают решения, играют решающую роль в принятии. Особенно в контексте принятия моральных решений прозрачность и подотчетность алгоритмов имеют жизненно важное значение.

«Многие компании уже используют ИИ для принятия решений о найме и планирования компенсаций, а государственные органы применяют ИИ в стратегиях охраны порядка и условно-досрочного освобождения. Наши результаты свидетельствуют о том, что при улучшении согласованности алгоритмов общественность может все больше поддерживать алгоритмические системы принятия решений даже в морально значимых областях».

«При правильном подходе к ИИ это может реально улучшить принятие политики и управленческих решений, таких как повышение зарплаты или выплата бонусов».

Марина Чугунова и др.,

Ruled by robots: предпочтение алгоритмических лиц, принимающих решения, и восприятие их выбора

Public Choice (2024).

DOI: 10.1007/s11127-024-01178-w